Os limites movediços da ética

Futuros em alerta

Por Luis Vidigal

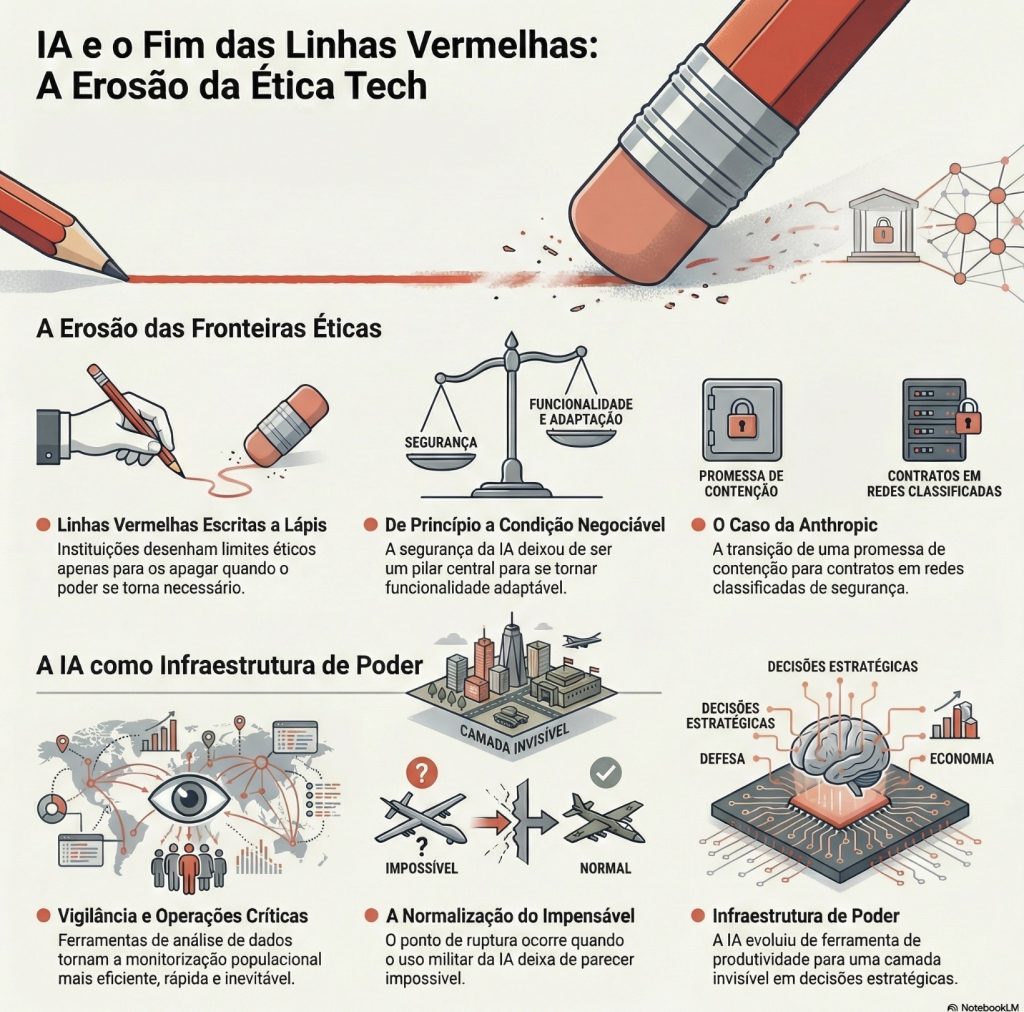

Houve um tempo em que as instituições desenhavam linhas vermelhas para não as cruzar. Hoje, desenham-nas a lápis, não para as respeitar, mas para poder apagá-las quando for conveniente. O processo é discreto, com uma concessão aqui e uma exceção ali. Nada que pareça definitivo e nada que pareça uma rendição.Futuros em alerta…

A Anthropic construiu a sua reputação com base numa promessa de contenção, rara no mundo tecnológico. Falava de inovação com limites e de segurança como um princípio e não como uma funcionalidade. Garantia que os seus sistemas não seriam usados para vigilância em larga escala contra populações, nem integrados em armamento autónomo capaz de decidir sobre a vida humana sem intervenção direta. Havia, pelo menos em teoria, uma fronteira ética clara.

Mas o poder tem a tendência inevitável de se expandir. Quando encontra uma ferramenta capaz de analisar quantidades massivas de dados, identificar padrões invisíveis e acelerar decisões críticas, deixa de a ver como opcional e passa a vê-la como necessária.

Foi assim que a inteligência artificial entrou nas redes classificadas e nas operações de segurança nacional dos EUA, através de contratos, parcerias e justificações técnicas. A Palantir abriu a porta e a Anthropic atravessou-a. Do outro lado, a ética deixou de ser um limite fixo e passou a ser uma condição negociável.

A suspeita de que sistemas como o Claude possam ter sido usados numa operação para capturar um chefe de Estado na Venezuela não é importante apenas pelo que prova, mas pelo que revela. O que mudou não foi apenas a tecnologia, mas o campo do possível. O simples facto de essa hipótese parecer plausível mostra que a distância entre ferramentas de análise e instrumentos de poder operacional diminuiu. O verdadeiro ponto de ruptura não é o primeiro uso, é o momento em que esse uso deixa de parecer impensável.

A mesma lógica aplica-se à vigilância. Sistemas criados para analisar informação podem, com pequenas adaptações, ser usados para monitorizar populações inteiras. Podem cruzar dados, prever comportamentos e identificar indivíduos em escala. Não precisam de vigiar diretamente, basta que tornem a vigilância mais eficiente, mais rápida e mais inevitável.

A linguagem institucional continua tranquila. Fala-se de “uso legal”, como se a legalidade resolvesse todas as questões morais. Fala-se de “segurança nacional”, como se essa expressão justificasse qualquer capacidade técnica. Fala-se de “apoio à decisão”, como se apoiar não fosse já participar.

As instituições raramente abandonam os seus princípios de uma só vez, fazem-no gradualmente. Cada nova exceção é apresentada como necessária, cada novo uso é descrito como limitado, mas cada passo redefine o próximo. O que ontem era impensável, hoje torna-se discutível e o que hoje é discutível, amanhã torna-se normal.

O resultado é uma transformação silenciosa, pois a inteligência artificial deixou de ser apenas uma ferramenta de produtividade, tornou-se uma infraestrutura de poder e uma camada invisível que influencia decisões militares, políticas e estratégicas.

O verdadeiro perigo não é que as máquinas decidam sozinhas. É que as instituições deixem de impor limites claros ao seu uso. Porque uma máquina não escolhe os seus limites, apenas executa aquilo que lhe é permitido. Quando esses limites desaparecem, não é a tecnologia que falhou, é quem decidiu que já não eram necessários.